네이버 서치 어드바이저(NAEVR Search Advisor)는 웹사이트나 블로그 등의 검색수집, 색인반영 현황을 제공하고 검색에 최적화 된 사이트로 관리하는데 필요한 진단 리포트 등을 제공하는 웹마스터 도구 입니다. 네이버 웹마스터 도구인 NAEVR Search Advisor는 블로그나 웹사이트를 간단하게 체크하거나 사이트를 등록하고 사이트맵과 RSS를 제출하여 네이버 검색로봇이 글을 수집 할 수 있도록 하고, 수집 현황과 사이트 확산 등의 다양한 부가기능을 제공하여 편리하게 이용할 수 있습니다.

1. NAEVR Search Advisor robots.txt 파일 생성하는 방법

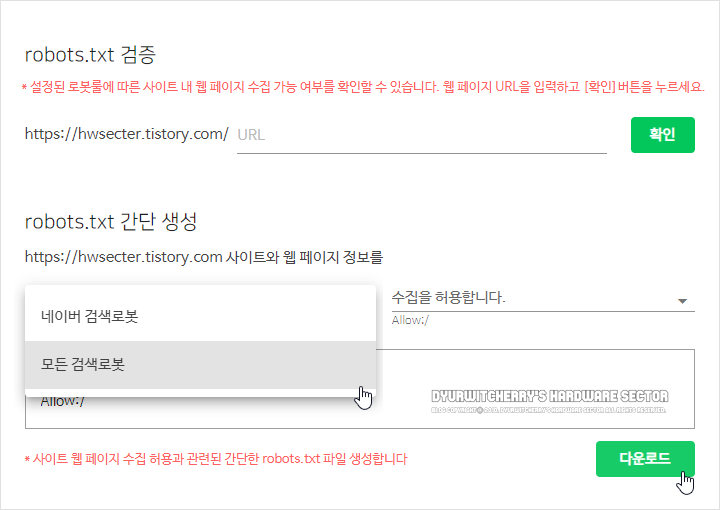

검색로봇에게 사이트 및 웹페이지를 수집할 수 있도록 허용하거나 제한하는 국제 권고안인 robots.txt는 네이버 웹마스터 도구인 네이버 서치 어드바이저(NAEVR Search Advisor)의 '웹마스터 도구 - 검증' 메뉴의 'robots.txt 간단 생성'에서 네이버 검색 로봇이 수집을 허용하도록 'User-agent: Yeti', 'Allow:/'의 'robots.txt' 파일을 생성하여 다운로드 할 수 있습니다.

2. 네이버 검색로봇과 모든 검색로봇 수집 허용하는 방법

네이버 서치 어드바이저의 기본 옵션에서 생성한 'robots.txt' 파일은 네이버 검색로봇 'User-agent: Yeti', 수집을 허용합니다.는 'Allow:/'의 경우는 네이버 검색의 접근에 대한 내용으로, 구글이나 빙, 다음 등 다른 검색 모두를 허용하기 위해서는 robots,txt 간단 생성의 '네이버 검색로봇' 우측 '▼' 하단 콤보 버튼을 눌러 '모든 검색로봇'을 선택합니다.

네이버 서치 어드바이저의 robots.txt 간단 생성 항목을 '네이버 검색로봇'에서 '모든 검색로봇'으로 선택하여 검색 로봇 텍스트를 생성하면, 'User-agent: *', 'Allow:/'의 내용으로 생성되어 네이버 외 구글이나 빙 검색, 다음 등의 모든 검색엔진에서 접근하여 수집을 허용하는 'robots.txt ' 파일이 생성되고 다운로드 버튼을 이용하여 다운로드 받아 사용할 수 있습니다. 참고로 네이버 웹마스터도구에서 생성한 첨부파일의 'robots.txt ' 파일을 다운로드 받아 텍스트 파일 (text/plain) 로 접근이 가능한 블로그나 사이트의 루트 디렉터리에 업로드 한 후 수집요청을 하여도 검색 엔진에 반영됩니다.

'인터넷팁' 카테고리의 다른 글

| 마이크로소프트 계정 만들기 ft. Microsoft Bing Account (0) | 2023.04.13 |

|---|---|

| 네이버 탈퇴하기 및 NAVER 회원 탈퇴 후 재가입 기간 정리 (0) | 2023.03.03 |

| 구글 계정 보안 2단계 인증으로 계정 보호 설정하는 방법 (0) | 2022.08.19 |

| 트위터 비밀번호 변경 및 계정 잠김 해제하는 방법 (6) | 2018.01.17 |

| Windows Defender 자동 샘플 전송 설정 해제하는 방법 (2) | 2017.03.21 |

댓글